U avgustu je NVIDIA predstavila Blackwell u MLPerf v4.1 AI Inference benchmark testovima, gde je pokazao značajna poboljšanja performansi u poređenju s prošlogeneracijskim Hopper čipovima, kao i u odnosu na konkurenciju. Danas NVIDIA predstavlja prve rezultate Blackwell benchmarka u MLPerf v4.1 AI testovima za obuku, koji pokazuju impresivne rezultate.

NVIDIA navodi da je potražnja za računarstvom u AI segmentu u stalnom porastu eksponencijalnim tempom, sa sve češćim lansiranjem novih modela. To zahteva ubrzane sposobnosti kako obuke, tako i inferencije. Inferencijski radni zadaci testirani su pre nekoliko meseci, a sada je vreme za testove obuke koji obuhvataju isti set radnih zadataka kao što su:

- Llama 2 70B (fino podešavanje LLM-a)

- Stable Diffusion (tekst u sliku)

- DLRMv2 (preporučivač)

- BERT (NLP)

- RetinaNet (detekcija objekata)

- GPT-3 175B (pre-obuka LLM-a)

- R-GAT (neuronska mreža grafova)

Ovo su neki od najpopularnijih i najraznovrsnijih slučajeva upotrebe za evaluaciju performansi obuke AI akceleratora, a svi su obuhvaćeni MLPerf Training 4.1 testovima. Ovi zadaci su veoma precizni kada je u pitanju vreme potrebno za obuku (izraženo u minutima) za potrebnu evaluaciju i podržava ih konzorcijum MLCommons sa više od 125 članova i partnera, što pomaže da se testovi usklade sa tržištem.

Počevši od Hopper-a, H100 GPU-ovi su sada 1,3 puta brži u performansama pre-obuke LLM-a po GPU-u od svoje prve prijave i nude najveće performanse u AI obuci među dostupnim čipovima u svakom benchmarku. NVIDIA je s Hopper-om postigla i najveću prijavu na MLPerf-u koristeći 11.616 Hopper H100 GPU-ova, gde su čipovi povezani u datacentarskoj skali koristeći NVLink, NVSwitch, ConnectX-7 SuperNIC i Quantum-X400 IB switch-eve.

Od lansiranja, NVIDIA Hopper GPU-ovi su povećali performanse zahvaljujući stalnim softverskim optimizacijama unutar CUDA AI staka, sada nudeći 6 puta veći rast performansi u odnosu na HGX A100 i 70% poboljšanja u odnosu na junsku prijavu HGX H100 za GPT-3 (175B Training) koristeći 512 GPU-ova u svakoj prijavi.

Zaokružujući prethodne Hopper benchmarke za inferencu, čipovi pružaju 1,9 puta veće performanse u Llama 3.1, 3 puta brže TTFT sa GH200 NVL32 i 1,5 puta veći throughput u Llama 3.1 405B, što ponovo naglašava kontinuirane inovacije u softverskom paketu.

Postoji razlog zašto konkurencija teško parira Hopper-u sa svojim novim čipovima, a kamoli sa Blackwell-om.

To nas dovodi do Blackwell-a, srca sledeće generacije AI centara podataka. Od samog početka, NVIDIA je postigla sedam rekorda po akceleratoru koristeći svoj Nyx AI superkompjuter, zasnovan na DGX B200 sistemima.

Ovaj superkompjuter nudi 2,2 puta brže fino podešavanje Llama 2 70B u odnosu na Hopper H100, 2 puta brže performanse u pre-obuci GPT-3 175B u poređenju sa Hopper H100, i takođe nadmašuje sve zadatke u okviru MLPerf Training 4.1 paketa.

Uz Blackwell, NVIDIA ne samo da udvostručuje performanse već uvodi napredan set tehnologija, detaljno predstavljenih na Hot Chips 2024 događaju. Štaviše, NVIDIA partneri takođe prikazuju izuzetne performanse na sistemima zasnovanim na Hopper tehnologiji, sa ukupno 11 prijava koje naglašavaju interesovanje za Hopper i Blackwell GPU-ove.

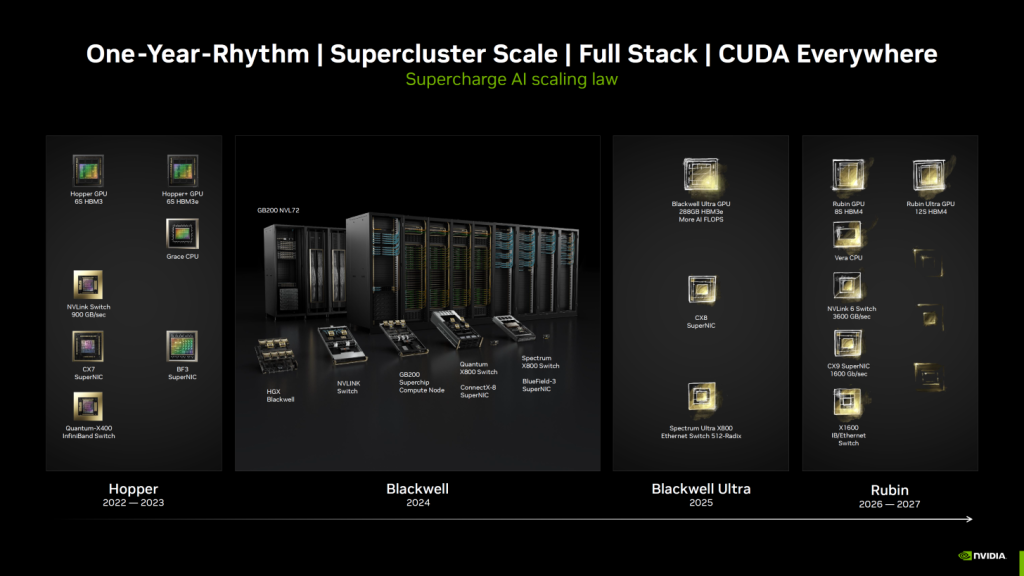

NVIDIA dodatno osvetljava svoj godišnji ritam, koji ne podrazumeva samo razvoj novih čipova što brže moguće, već i njihovu validaciju na nivou centara podataka i bržu primenu na skali superklastera.

NVIDIA jasno stavlja do znanja da nisu samo kompanija koja proizvodi čipove, već su i pružalac rešenja za centre podataka na velikoj skali.

Zato je kompanija već predstavila svoju sledeću AI roadmapu koja uključuje Blackwell Ultra kao naslednika Blackwell-a, sa više memorije (288 GB HBM3e) i većim kapacitetom obrade u 2025. godini. Očekuje se da će Blackwell Ultra platforma koristiti oznaku B300.

Sledeća generacija nakon toga biće Rubin, u standardnoj verziji koja izlazi 2026. godine, kao i verzije sa 8S HBM4 i 12S HBM4 koje su planirane za 2027. godinu. Na kraju, NVIDIA potvrđuje da je Blackwell sada u punoj masovnoj proizvodnji, pa se očekuju rekordni prihodi i performanse u narednim kvartalima.