AI se brzo razvija, i vreme je da se osvrnemo na to gde smo trenutno i šta nas očekuje u budućnosti. Fokusiraćemo se na sposobnosti AI modela, posebno Velikih Jezičkih Modela (LLM) koji stoje iza chatbota poput ChatGPT-a i Gemini-a. Ovi modeli postaju sve pametniji. Razumevanje zašto i kako to funkcioniše može nam pomoći da predvidimo buduće razvojne smerove.

Da bismo to shvatili, moramo pogledati kako se ovi modeli treniraju. Pokušaću da objasnim ovo bez previše tehničkih detalja, što znači da ću pojednostaviti neke složene ideje. Nadam se da će moji tehnički upućeni čitaoci oprostiti ovaj pristup.

Snaga skale u LLM-u

Ključ za razumevanje LLM-ova je skala. Jednostavno rečeno, veći modeli obično su pametniji. Kada kažemo „veći“, mislimo na modele sa više parametara – promenljivih vrednosti koje pomažu modelu da predvidi šta će reći sledeće. Ovi veći modeli zahtevaju više podataka za obuku (mereno u tokenima, koji su često reči ili delovi reči) i više računske moći (mereno u FLOP-ovima, ili Operacijama Sa Plutajućom Tačkom).

Zamislite FLOP-ove kao broj jednostavnih matematičkih operacija koje računar izvršava. Više FLOP-ova znači više računarskog posla tokom obuke AI modela. Rezultat? Modeli koji mogu da obrade teže zadatke, ostvaruju bolje rezultate na testovima i generalno deluju pametnije.

Evo stvarnog primera koji pokazuje zašto je skala važna. Bloomberg je stvorio specijalizovani AI pod nazivom BloombergGPT, obučen na njihovim ogromnim finansijskim podacima. Koristio je 200 ZetaFLOP-ova računske moći (to je broj 2 praćen sa 23 nule) i bio je odličan u zadacima poput analize finansijskih dokumenata. Međutim, GPT-4, model koji nije specifično obučen za finansije, ipak je bio bolji. Zašto? GPT-4 je jednostavno mnogo veći – oko 100 puta veći – što ga čini sposobnijim u različitim oblastima.

Međutim, izgradnja većih modela nije laka. Nije samo u pitanju prikupljanje više podataka. Potrebno je više vremena za obuku, više čipova i više energije. Da bi se dobio značajno bolji model, obično je potrebno da se podaci i računska moć povećaju za otprilike deset puta. A to obično znači da troškovi rastu za deset puta.

Različiti talasi LLM-a

Priča o napretku AI tehnologije u velikoj meri se svodi na povećanje veličine modela, prateći generacijski obrazac. Svaka nova generacija zahteva obimno planiranje i resurse kako bi se postigao taj desetostruki porast podataka i računske moći. Najnapredniji modeli u svakom trenutku nazivamo „frontierski modeli“.

Za jednostavnost, podelimo ove talase na sledeći način:

- Talasi modela 1 (2022): Pomislite na ChatGPT-3.5. Ovi modeli su pokrenuli bum Generativnog AI-a. Koriste manje od 10^25 FLOP-ova i obično koštaju manje od 10 miliona dolara za obuku. Ima mnogo modela Gen1, uključujući open-source verzije.

- Talasi modela 2 (2023-2024): GPT-4 je primer ovde. Ovi modeli zahtevaju između 10^25 i 10^26 FLOP-ova i mogu koštati preko 100 miliona dolara za obuku. Sada imamo nekoliko modela Gen2.

- Talasi modela 3 (2024-2026?): Iako još nisu prisutni, modeli kao što su GPT-5 i Grok 3 su na horizontu. Verovatno će im biti potrebno između 10^26 i 10^27 FLOP-ova i mogli bi koštati milijarde dolara za obuku.

- Talasi modela 4 i dalje: Možda ćemo ih videti za nekoliko godina, a njihova obuka može koštati preko 10 milijardi dolara. Većina stručnjaka s kojima sam razgovarao veruje da će koristi od skaliranja nastaviti barem kroz Gen4. Nakon toga, možda ćemo videti povećanje sposobnosti do 1.000 puta u odnosu na Gen3 do 2030. godine, ali to nije sigurno. Zato je toliko govora o pronalaženju energije i podataka za buduće modele.

GPT-4 je započeo eru Talasa 2, ali druge kompanije su već sustigle. Sada smo na pragu prvih modela Talasa 3. Pogledajmo top pet modela Talasa 2:

- GPT-4o: Ovaj model pokreće ChatGPT i Microsoft Copilot. Univerzalni je model koji rukuje glasom, slikama, fajlovima, generisanjem koda, pretragama po mreži i još mnogo toga.

- Claude 3.5 Sonnet: Pametan model koji se odlično snalazi u tekstu. Takođe može raditi sa slikama i fajlovima, ali ne generiše slike niti glas.

- Gemini 1.5 Pro: Google-ov vodeći model. Ima ogromnu memoriju, može obraditi različite tipove podataka uključujući video, i može pokretati kod (iako nije uvek jasno kada).

- Grok 2: Iznenađujući takmičar iz Elon Muskove X platforme.AI. Koristi Twitter za informacije i može kreirati slike bez mnogo ograničenja.

- Llama 3.1 405B: Meta-in model koji se izdvaja jer je open-source. Svako može da ga preuzme, koristi, pa čak i menja u određenoj meri.

Nova metoda skaliranja: Pristup razmišljanja

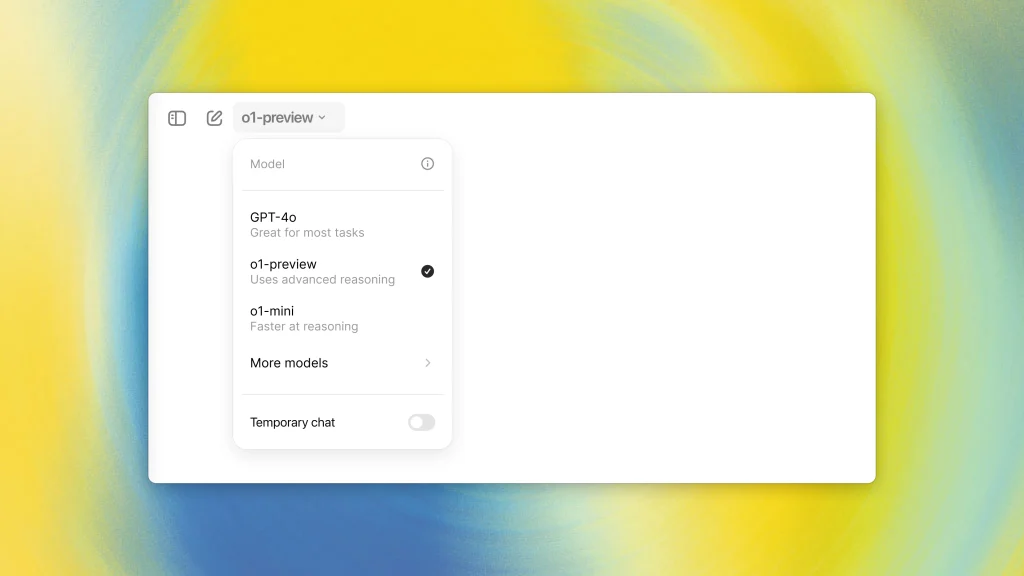

Nedavno je OpenAI otkrio prekretnicu sa svojim o1-preview i o1-mini modelima. Ovi modeli se skaliraju na drugačiji način – ne tokom obuke, već nakon nje. Naime, ispostavilo se da računarska snaga koja se koristi za „razmišljanje“ o problemu (nazvana inference compute) prati vlastiti zakon skaliranja.

Ovaj proces „razmišljanja“ podrazumeva da model pre nego što da odgovor, prođe kroz nekoliko koraka razmišljanja. OpenAI-ova inovacija bila je omogućavanje njihovim modelima da prođu kroz ovaj proces stvarajući skrivene tokene razmišljanja pre nego što daju konačan odgovor. Otkrili su nešto fascinantno: što duže model „razmišlja“, to je odgovor obično bolji.

Ovaj razvoj predstavlja značajnu promenu u pristupu veštačkoj inteligenciji, koja na zanimljiv način podseća na ljudske kognitivne procese. Da bismo razumeli njegov značaj, korisno je razmotriti koncept psihologa Daniela Kahnemana o razmišljanju u okviru Sistem 1 i Sistem 2.

Kahneman opisuje Sistem 1 kao brz, intuitivan i automatski način razmišljanja – tip razmišljanja koji koristimo kada prepoznajemo lice prijatelja ili odgovaramo na jednostavne matematičke zadatke kao što je 2+2. Sistem 2, s druge strane, je sporiji, promišljeniji i logičniji – razmišljanje koje koristimo kada rešavamo složene probleme ili donosimo teške odluke.

Tradicionalni LLM-ovi, na mnogo načina, su do sada funkcionisali uglavnom u načinu sličnom Sistemu 1. Oni pružaju brze, intuitivne odgovore zasnovane na obrascima iz podataka na kojima su trenirani. Iako impresivno, ovaj pristup može dovesti do grešaka ili površnog razumevanja, posebno za složena pitanja.

Novi OpenAI pristup sa modelima o1-preview i o1-mini uvodi proces razmišljanja sličan Sistemu 2 u veštačku inteligenciju. Omogućavanjem modelima da „razmišljaju“ kroz više koraka pre nego što odgovore, oni oponašaju promišljeni, logički pristup ljudskog Sistema 2 razmišljanja. Zbog toga se kvalitet odgovora poboljšava sa dužim vremenom razmišljanja – model zapravo angažuje dublju i temeljitiju analizu.

Zašto je ovo važno? Postoji nekoliko značajnih implikacija:

- Poboljšano rešavanje problema: Ovaj pristup omogućava veštačkoj inteligenciji da se bavi složenijim, nijansiranim problemima koji zahtevaju razmišljanje korak po korak, što može proširiti primenu AI u oblastima kao što su naučno istraživanje, strateško planiranje i kompleksno donošenje odluka.

- Povećana tačnost: Angažovanjem u dubljem razmišljanju, ovi modeli će verovatno proizvoditi tačnije i pouzdanije rezultate, smanjujući rizik od „halucinacija“ ili grešaka koje mogu nastati prilikom brzih, intuitivnih odgovora.

- Smanjenje pristrasnosti: Sa sofisticiranijim treniranjem, većim skupovima podataka i naprednim sposobnostima razmišljanja, ovi modeli često mogu pružiti uravnoteženije i tačnije odgovore. Ovo je ključno za proširenje primene AI u osetljivim područjima kao što su dijagnostika u zdravstvu ili pravna analiza, gde je nepristrasnost od ključnog značaja.

- Transparentnost i objašnjivost: Proces razmišljanja korak po korak mogao bi učiniti donošenje odluka pomoću AI-a transparentnijim i objašnjivijim, što je ključni faktor za izgradnju poverenja u AI sisteme, posebno u osetljivim primenama.

- Kognitivno usklađivanje: Ovaj razvoj dovodi razmišljanje AI-a bliže ljudskim kognitivnim procesima, što može dovesti do prirodnije i efikasnije saradnje između ljudi i AI.

Put prema agentnoj AI

Napredak u sposobnostima razmišljanja veštačke inteligencije otvara put ka agentnoj AI – autonomnim sistemima koji mogu da percipiraju, odlučuju i deluju kako bi postigli ciljeve. Modeli poput o1-preview, sa višestepenim razmišljanjem, ključni su korak prema ovoj budućnosti.

Agentna AI ide dalje od odgovaranja na upite; ona se angažuje sa svojim okruženjem, postavlja ciljeve i radi na njihovom ostvarivanju. Takva AI bi mogla da razlaže složene ciljeve, predviđa prepreke i prilagođava strategije. U naučnim istraživanjima, mogla bi da formuliše hipoteze i dizajnira eksperimente. U poslovanju, mogla bi da analizira trendove i predloži strateške odluke.

Ključ je u sposobnosti AI da kombinuje brzo prepoznavanje obrazaca (slično sistemu 1) sa delibertivnom analizom (slično sistemu 2). Ovo omogućava navigaciju kroz složene scenarije sa neviđenom nijansiranošću i prilagodljivošću. Rezultat bi mogli biti AI agenti koji razumeju kontekst, ocenjuju napredak i autonomno prilagođavaju svoj pristup.

Međutim, ovaj pomak ka agentnoj AI postavlja ključna etička i praktična pitanja. Kako da obezbedimo usklađenost sa ljudskim vrednostima i održimo značajnu kontrolu? Ovi izazovi će biti ključni dok prelazimo ka istinski agentnoj AI, što bi moglo drastično promeniti naš odnos sa veštačkom inteligencijom.