Zamislite da se probudite ujutru, otvorite telefon i vidite svet koji je savršeno skrojen samo za vas. Vaše vesti su tačno one koje vas ljute ili raduju, vaši prijatelji dele samo mišljenja koja potvrđuju vaša, a reklame su toliko precizne da se čini da vam neko čita misli. Zvuči kao savršeno korisno iskustvo? Možda. Ali ta ista tehnologija, koju zovemo hiper-personalizacija, stvara filter bubble (filter mehurić) koji nas zatvara u sopstvene realnosti i razdvaja društvo na način koji nikada ranije nije bio moguć.

Ja sam godinama pratio kako se algoritmi društvenih mreža razvijaju, i moram priznati: ono što vidimo 2026. godine je kulminacija problema koji je Eli Pariser opisao još 2011. godine u svojoj knjizi „The Filter Bubble“. Tada je to zvučalo kao upozorenje. Danas je to svakodnevica. AI ne samo da predviđa šta ćete kliknuti – on vas vodi kroz tunel gde se suprotna mišljenja gotovo nikad ne pojavljuju. Rezultat? Polarizacija koja nije samo politička – ona je emotivna, kulturna, pa čak i lična. A najgore je što mi sami dopuštamo da se to dešava, jer je udobno.

U ovom tekstu ćemo duboko zaroniti u to kako AI hiper-personalizacija radi, zašto dovodi do krize filter bubble-a, kakvi su stvarni primeri iz 2025. i 2026. godine, i – najvažnije – šta možemo da uradimo da izađemo iz ovog mehurića. Neću vas ulepšavati: situacija je ozbiljna, ali nije beznadežna. Ako ste programer, korisnik društvenih mreža ili samo neko ko brine za društvo, ovo je tekst za vas. I verujte mi, poželećete da ga podelite sa prijateljima koji su zaglavljeni u svom mehuriću.

Šta je filter bubble i zašto ga AI čini opasnijim nego ikad?

Filter bubble je termin koji je skovao Eli Pariser da opiše stanje u kojem algoritmi personalizovanih pretraga, preporuka i feed-ova selektivno prikazuju sadržaj koji potvrđuje vaše postojeće stavove, a kriju ono što bi vas izazvalo ili nateralo da razmišljate drugačije. To nije slučajnost – to je dizajn.

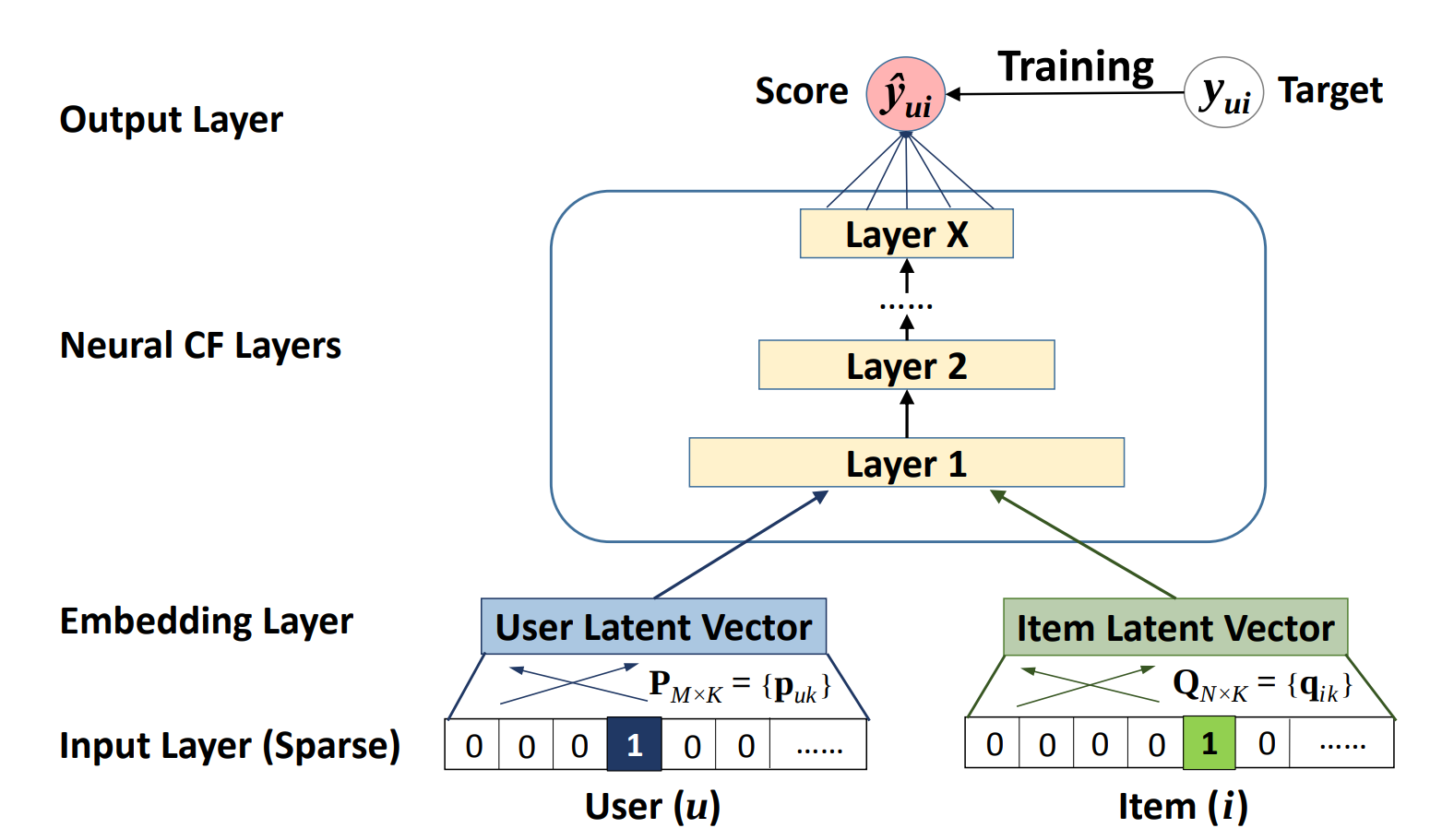

U 2026. godini, sa napretkom generative AI i recommendation systems (sistema preporuka), ovo je postalo hiper-personalizacija. Algoritmi ne samo da znaju šta volite – oni znaju kako se osećate u datom trenutku, šta vas ljuti, šta vas plaši, i kako da vas zadrže na platformi što duže. TikTok, YouTube, Instagram, pa čak i Netflix i Spotify – svi koriste AI modele poput collaborative filtering, content-based filtering i deep learning-based recommendation da vas „drže“ u feed-u.

Prema studiji iz 2025. godine sa Harvard Kennedy School, kratkoročno izlaganje filter bubble recommendation systems nema veliki uticaj na polarizaciju. Ali dugoročno? Tu je problem. Korisnici koji provode sate u feed-u postaju sve više ekstremni u svojim stavovima, jer algoritam nagrađuje angažman – a najveći angažman dolazi od sadržaja koji izaziva emocije: ljutnju, strah, superiornost.

U Srbiji, gde su društvene mreže glavni izvor vesti za preko 60% populacije (prema podacima iz 2025), ovo ima direktne posledice. Vidite samo vesti koje odgovaraju vašoj političkoj strani, i vremenom počinjete da verujete da je suprotna strana „zla“ ili „idioti“. To nije teorija zavere – to je matematika.

Kako AI algoritmi stvaraju ovu individualizovanu realnost?

Sve počinje sa podacima. Svaki klik, svaki pauz, svaki scroll – sve se beleži. AI modeli, uglavnom bazirani na neural networks i reinforcement learning, koriste ove podatke da predvide sledeći korak.

Na primer, TikTok-ov algoritam (For You Page) je poznat po tome što u prvim minutima testira sadržaj na osnovu vaših interakcija, a zatim gradi profil. U 2026. godini, prema izveštajima sa Social Media Today, algoritam je promenjen da prioritetizuje watch time (vreme gledanja) umesto views-a, što znači da vas drži u niche content-u duže – i to je često ekstremniji sadržaj.

YouTube koristi sličan pristup: ako gledate video o klimatskim promenama sa skeptičnog stanovišta, dobićete još sličnih, sve radikalnijih. Studija iz 2025. sa Northeastern University pokazala je da „hijacking“ algoritma (simulacija korisnika koji prelazi na ekstremni sadržaj) dovodi do brzog radikalizovanja.

A sada, sa generative AI, ovo ide dalje. Modeli poput GPT-4o ili Grok-3 mogu generisati personalizovani sadržaj u realnom vremenu – komentare, odgovore, čak i vesti koje se prilagođavaju vašem profilu. Rezultat? Vaša realnost postaje još izolovanija.

Primeri iz prakse: Kako filter bubble radi u stvarnom svetu 2025–2026

Hajde da pogledamo konkretne slučajeve.

- TikTok i radikalizacija: U 2025. godini, istraživači su pokazali da ako korisnik počne da interaguje sa transphobičnim sadržajem, algoritam brzo povećava količinu far-right videa. To nije greška – to je dizajn za maksimalni engagement.

- YouTube rabbit holes: Prema Washington Post-u iz januara 2026., vizualizacija TikTok algoritma pokazuje kako se korisnici brzo zatvaraju u mehuriće. Isto važi za YouTube – jedan video o vakcinama može vas odvesti do teorija zavere u roku od 30 minuta.

- Politička polarizacija: U Americi, algoritmi su doprineli polarizaciji tokom izbora 2024. U Srbiji? Zamislite feed pun vesti o „izdaji“ ili „pobedi“ – bez ikakvog balansiranja. To stvara društvo gde se ljudi više ne razgovaraju, već se sukobljavaju.

- Marketing i hiper-personalizacija: Kompanije poput Zeta Global predviđaju da će u 2026. AI omogućiti „konverzacijske“ kampanje – reklame koje se osećaju kao lični razgovor. Ali to znači da vidite samo ono što vas navodi da kupujete, bez izazova.

Ovi primeri nisu izmišljeni – oni su dokumentovani u studijama iz 2025. i 2026.

Posledice: Zašto je ovo kriza za društvo?

Polarizacija nije samo „različita mišljenja“. To je duboka podela gde ljudi žive u paralelnim realnostima.

- Emotivna polarizacija: Ljudi ne samo da se ne slažu – oni se mrze.

- Dezinformacije: Filter bubble pojačava fake news, jer se one brže šire u mehurićima.

- Smanjena empatija: Ako nikad ne vidite suprotno mišljenje, teško je razumeti druge.

- Političke posledice: U 2026., prema Brookings-u, platforme koje manje promovišu divisive content mogu smanjiti polarizaciju.

U Srbiji, gde su društvene mreže glavni kanal komunikacije, ovo može dovesti do veće društvene tenzije.

Rešenja: Kako izaći iz filter bubble-a?

Nije sve crno. Postoje načini da se borimo.

- Individualni nivou: Koristite ekstenzije poput „Escape Your Bubble“ ili „The Perspective“ platformu koja pokazuje dve strane priče. Diversifikujte feed – pratite suprotne stavove.

- Platformski nivou: Algoritmi mogu biti dizajnirani da ubacuju diverse content. Prema ACM studiji iz 2025, KG edge inversion (inverzija veza u knowledge graph-u) može simulirati suprotne poglede.

- Regulacije: EU AI Act i slične regulacije zahtevaju transparentnost. U 2026, očekujemo više zakona o algorithmic bias.

- Edukacija: Media literacy je ključ. Učite decu da prepoznaju filter bubble.

- Budućnost: Sa AI agentima, možemo imati personalizovane „diversity filters“ koji nas izazivaju.

Budućnost: Šta nas čeka 2026–2030.?

U skoroj budućnosti, hiper-personalizacija će biti još jača. PwC predviđa da će AI agentic workflows omogućiti još dublju personalizaciju. Ali rizik je ogroman – ako ne intervenišemo, polarizacija će rasti.

Ipak, optimističan sam: sa open-source AI i većom svesnošću, možemo preokrenuti trend.

Vreme je da probijemo mehurić

Filter bubble nije neizbežan. To je izbor – naš i platformi. Ako ne uradimo ništa, društvo će se dalje razdvajati. Ali ako delimo znanje, tražimo različite poglede i zahtevamo bolje algoritme, možemo izgraditi bolji digitalni svet.

Podsetite se – sledeći put kada skrolujete, pitajte se – da li ovo vidim zato što je istina, ili zato što mi se sviđa?