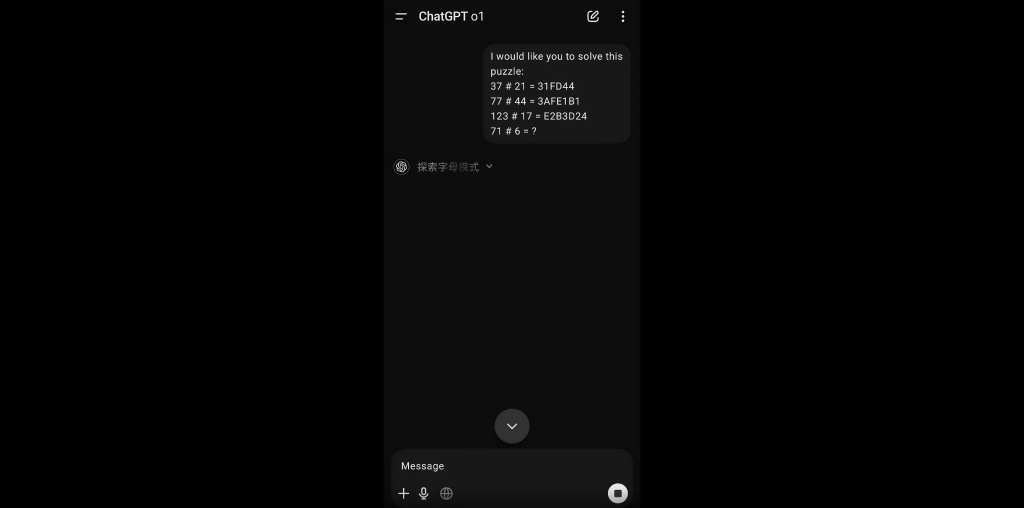

Nedugo nakon što je OpenAI predstavio o1, svoj prvi AI model za „rezonovanje,“ korisnici su primetili zanimljiv fenomen. Model bi povremeno počeo da „razmišlja“ na kineskom, persijskom ili nekom drugom jeziku — čak i kada je pitanje postavljeno na engleskom.

Na primer, kada bi dobio zadatak poput „Koliko slova R ima u reči ‘strawberry’?“ o1 bi započeo proces razmišljanja i došao do odgovora kroz niz koraka rezonovanja. Ako je pitanje napisano na engleskom, konačni odgovor bi bio na engleskom. Međutim, tokom nekih koraka zaključivanja, model bi koristio drugi jezik pre nego što bi došao do svog zaključka.

„[O1] je nasumično počeo da razmišlja na kineskom na pola procesa,“ napisao je jedan korisnik na Reddit-u.

„Zašto je [o1] nasumično počeo da razmišlja na kineskom?“ pitao je drugi korisnik u objavi na platformi X. „Ni jedan deo razgovora (5+ poruka) nije bio na kineskom.“

OpenAI još uvek nije pružio objašnjenje za neobično ponašanje modela o1 — niti ga je zvanično priznao. Šta bi moglo da se dešava?

Stručnjaci za veštačku inteligenciju nisu sigurni, ali imaju nekoliko teorija.

Neki korisnici na platformi X, uključujući generalnog direktora Hugging Face-a Klemana Dlangea, aludirali su na činjenicu da se modeli za rezonovanje poput o1 treniraju na skupovima podataka koji sadrže veliki broj kineskih znakova. Ted Sjao, istraživač u Google DeepMind-u, tvrdi da kompanije poput OpenAI-a koriste usluge označavanja podataka treće strane iz Kine, te da je prelazak o1 na kineski primer „lingvističkog uticaja kineskog jezika na rezonovanje.“

„[Laboratorije poput] OpenAI-a i Anthropic-a koriste [treće strane] za označavanje podataka za rezonovanje na nivou doktorskih studija za nauku, matematiku i programiranje,“ napisao je Sjao u objavi na platformi X. „Zbog dostupnosti stručne radne snage i troškova, mnogi od ovih pružalaca usluga dolaze iz Kine.“

Oznake, poznate i kao tagovi ili anotacije, pomažu modelima da razumeju i interpretiraju podatke tokom procesa obuke. Na primer, oznake za treniranje modela za prepoznavanje slika mogu uključivati obeležavanje objekata ili natpise koji se odnose na svaku osobu, mesto ili predmet prikazan na slici.

Studije su pokazale da pristrasne oznake mogu proizvesti pristrasne modele. Na primer, prosečan anotator je skloniji da fraze na afroameričkom kolokvijalnom engleskom (AAVE), neformalnoj gramatici koju koriste neki Afroamerikanci, označi kao toksične, što dovodi do toga da detektori toksičnosti trenirani na tim oznakama AAVE vide kao nesrazmerno toksičan.

Međutim, neki stručnjaci odbacuju hipotezu o kineskim oznakama podataka za o1. Ukazuju na to da je o1 podjednako sklon prelasku na hindi, tajlandski ili neki drugi jezik, dok pokušava da pronađe rešenje.

Umesto hipoteze o kineskim oznakama podataka, stručnjaci tvrde da o1 i drugi modeli za rezonovanje možda jednostavno koriste jezike koje smatraju najefikasnijim za postizanje ciljeva (ili haluciniraju).

„Model ne zna šta je jezik, niti da se jezici razlikuju,“ izjavio je Metju Guzdial, istraživač veštačke inteligencije i docent na Univerzitetu Alberta. „Za njega je sve samo tekst.“

Slično kao oznake, tokeni mogu uneti pristrasnosti. Na primer, mnogi prevodioci reči u tokene pretpostavljaju da razmak u rečenici označava novu reč, iako ne koriste svi jezici razmake za odvajanje reči.

Tiežen Vang, softverski inženjer u AI startapu Hugging Face, slaže se s Guzdialom da jezičke nekonzistencije modela za rezonovanje mogu biti objašnjene asocijacijama koje su modeli napravili tokom obuke.

„Prihvatanjem svake jezičke nijanse, širimo pogled modela na svet i omogućavamo mu da uči iz čitavog spektra ljudskog znanja,“ napisao je Vang u objavi na platformi X. „Na primer, više volim da radim matematiku na kineskom jer je svaki broj samo jedan slog, što čini proračune jasnim i efikasnim. Ali kada su u pitanju teme poput nesvesne pristrasnosti, automatski prelazim na engleski, uglavnom zato što sam te ideje prvi put učio na tom jeziku.“

Vangova teorija je verovatna. Na kraju krajeva, modeli su probabilističke mašine. Obučeni na velikom broju primera, oni uče obrasce kako bi pravili predikcije, poput toga da „za koga“ u mejlu obično prethodi „možda zanima.“

Međutim, Luka Soldaini, naučni istraživač u neprofitnoj organizaciji Allen Institute for AI, upozorava da ne možemo biti sigurni. „Ovu vrstu opažanja na implementiranom AI sistemu je nemoguće dokazati zbog netransparentnosti tih modela,“ izjavio je. „To je jedan od mnogih razloga zašto je transparentnost u načinu izgradnje AI sistema fundamentalna.“

Bez odgovora od strane OpenAI-a, ostaje nam da nagađamo zašto o1 razmišlja o pesmama na francuskom, dok o sintetičkoj biologiji razmišlja na mandarinskom.