Ratovanje se kroz istoriju menjalo – od mačeva i štitova, preko baruta, pa sve do nuklearnog odvraćanja. Međutim, danas prisustvujemo verovatno najjezivijoj transformaciji do sada. Sukobi postaju apstraktni, svedeni na piksele i grafikone na ekranu. Kada se rat pretvori u interaktivni kontrolni panel (dashboard), gubi se ljudskost, a odluke o životu i smrti donose se brzinom kojom procesor obrađuje podatke.

Ova tehnološka revolucija u naoružanju, o kojoj piše R. Pillai, otvara pitanja koja prevazilaze vojnu strategiju i duboko zadiru u samu suštinu naše moralnosti.

Gejmifikacija destrukcije

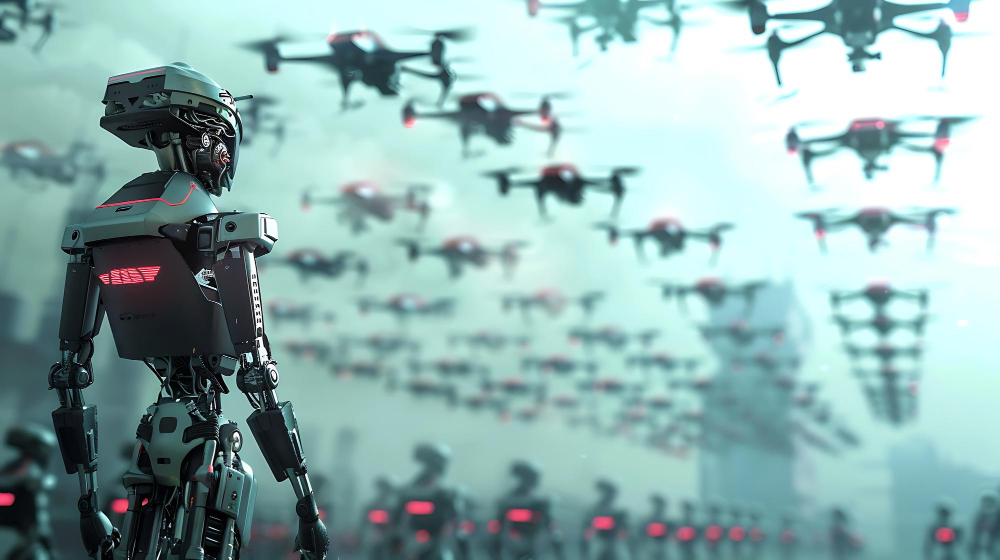

Glavni problem sa uvođenjem napredne veštačke inteligencije u vojne operacije je „desenzitizacija“ operatera. Kada vojni zvaničnik ili operater drona posmatra ciljeve koje je obeležio algoritam, ti ciljevi više nisu ljudi, već tačke na mapi ili procenti verovatnoće. Veštačka inteligencija analizira ogromne količine podataka, identifikuje obrasce i predlaže udare sa preciznošću koja je ranije bila nezamisliva.

Međutim, upravo ta preciznost stvara iluziju „čistog rata“. Ako ekran pokazuje da je cilj neutralisan sa minimalnom kolateralnom štetom, donosilac odluke može osetiti manju moralnu težinu nego vojnik na terenu. Rat postaje sličan video igri, gde se gubici mere statistikom, a ne ljudskom patnjom.

Algoritmi kao sudije i dželati

Algoritmi kao sudije i dželati

Sistemi poput onih koje razvijaju kompanije u okviru odbrambenih sektora, koriste mašinsko učenje za predviđanje neprijateljskih poteza. Ipak, AI modeli pate od nečega što stručnjaci nazivaju „crna kutija“ (black box). To znači da često ne znamo tačno zašto je algoritam doneo određenu odluku ili identifikovao nekoga kao pretnju.

U ratnim uslovima, gde su podaci često nepotpuni ili namerno manipulisani, oslanjanje na AI može dovesti do katastrofalnih grešaka. Ako algoritam pogreši, ko snosi odgovornost? Programer, general koji je odobrio upotrebu softvera ili sama mašina? Pravni vakuum koji okružuje autonomno oružje (LAWS – Lethal Autonomous Weapons Systems) jedan je od najvećih izazova pred UN i međunarodnim pravom.

Psihološka distanca i gubitak empatije

Dizajniranje ratnih interfejsa tako da izgledaju kao moderni poslovni alati za analitiku stvara opasnu psihološku distancu. Kada smrt postane stavka u izveštaju koji generiše AI, empatija nestaje. U tradicionalnom sukobu, neizvesnost i strah su služili kao prirodne kočnice totalnoj eskalaciji. U svetu gde AI optimizuje svaki napad, te kočnice polako popuštaju.

Dodatno, upotreba AI u sajber ratovanju omogućava napade koji mogu paralisati čitave države bez ispaljenog metka, ciljajući elektroenergetske mreže ili bolničke sisteme. Ovakvi napadi su često anonimni, što povećava rizik od paranoje i ishitrenih reakcija na globalnom nivou.

Trka u naoružanju koju niko ne kontroliše

Nalazimo se u novoj hladnoratovskoj trci, ali ovog puta se ne takmičimo u broju bojevih glava, već u kvalitetu koda i brzini procesora. Države se plaše da će, ako uvedu etička ograničenja na razvoj vojnog AI-a, njihovi protivnici to iskoristiti. Rezultat je nekontrolisan razvoj tehnologija koje bi jednog dana mogle donositi odluke nezavisno od ljudske komande.

Stručnjaci upozoravaju da bi AI sistemi mogli da eskaliraju sukob brže nego što diplomatija može da reaguje. Algoritmi su programirani da pobeđuju, a u ratu to može značiti upotrebu najekstremnijih mera pre nego što ljudi uopšte postanu svesni da je situacija izmakla kontroli.

Zaključak

Zaključak

Veštačka inteligencija u ratovanju nije samo pitanje tehnološkog napretka; to je ogledalo naše civilizacije. Ako dopustimo da rat postane samo još jedan set podataka na digitalnom panelu, rizikujemo da izgubimo ono što nas čini ljudima – sposobnost da osetimo težinu sopstvenih postupaka.

Tamna strana AI konflikata leži u tišini ekrana i odsustvu griže savesti. Tehnologija bi trebalo da nam služi da sprečimo patnju, a ne da je učinimo efikasnijom i nevidljivijom. Pre nego što predamo ključeve bojišta algoritmima, moramo se zapitati: kakav mir možemo očekivati od mašina koje su dizajnirane samo da bi pobedile u igri brojeva?

Napomena za čitaoce: Ovaj tekst je informativnog karaktera i bavi se analizom modernih tehnoloških trendova u bezbednosnom sektoru. Budućnost ratovanja zavisi od etičkih okvira koje postavimo danas.