Manipulacija i dezinformacija uz pomoć AI – Kako se AI može zloupotrebiti za širenje dezinformacija i manipulaciju javnim mnjenjem (deo 1) – https://www.itnetwork.rs/manipulacija-i-dezinformacija-uz-pomoc-ai-kako-se-ai-moze-zloupotrebiti-za-sirenje-dezinformacija-i-manipulaciju-javnim-mnjenjem-deo-1/

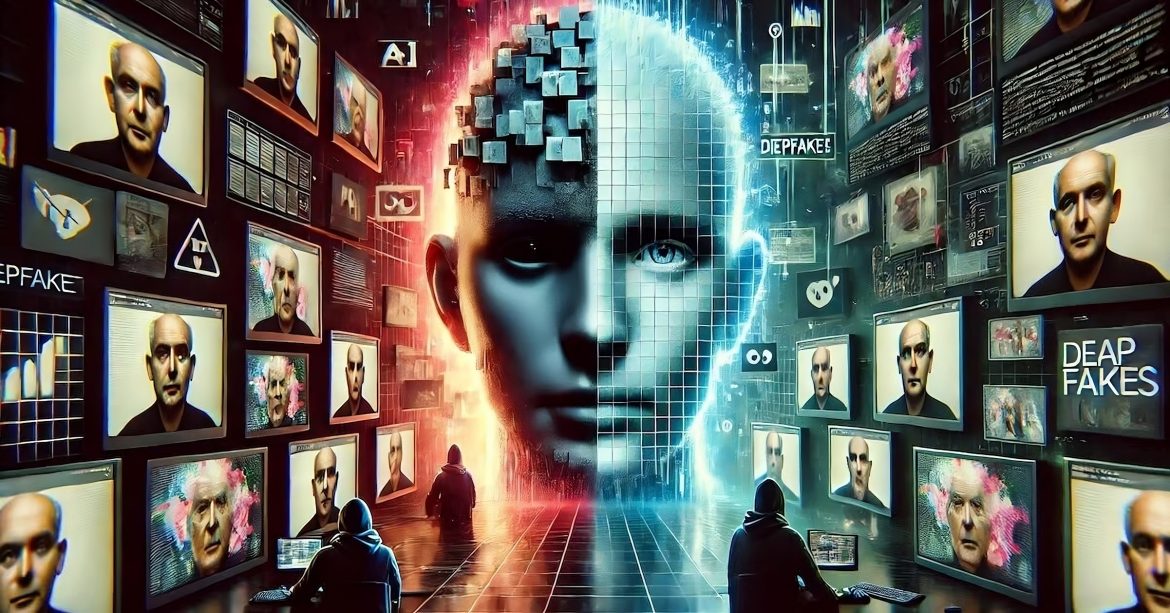

Duboke lažne informacije (deepfake) predstavljaju jedan od najopasnijih oblika digitalne manipulacije u današnjem svetu. Korišćenjem veštačke inteligencije, deepfake tehnologija omogućava kreiranje veoma uverljivih, ali lažnih videa, fotografija i audio-zapisa. Ovakvi sadržaji se najčešće koriste za obmanjivanje javnosti, diskreditovanje javnih ličnosti i institucija, kao i za širenje dezinformacija sa različitim ciljevima, od političkih do finansijskih. Sa sve većom dostupnošću ove tehnologije, postaje izazov prepoznati i odbraniti se od deepfake sadržaja koji se brzo i lako širi na internetu.

Kako funkcioniše deepfake tehnologija?

Deepfake tehnologija koristi složene modele mašinskog učenja i veštačke neuronske mreže za kreiranje lažnih vizuelnih i audio sadržaja. U osnovi ove tehnologije nalazi se tehnika pod nazivom „Generative Adversarial Networks“ (GANs), koja uključuje dve neuronske mreže koje međusobno sarađuju i nadmeću se se. Prva mreža, „generator,“ stvara lažne slike, video ili audio zapise, dok druga mreža, „diskriminator,“ procenjuje tačnost tih podataka i pokušava da razlikuje stvarni sadržaj od lažnog. Tokom vremena, generator postaje sve bolji u stvaranju lažnog sadržaja koji je gotovo nemoguće razlikovati od originala.

Deepfake tehnologija omogućava da se lice jedne osobe „zalepi“ na lice druge osobe u video-snimku ili fotografiji, ili da se izgovorene reči određene osobe promene tako da izgleda kao da je izjavila nešto što nikada nije izjavila.

Upotreba deepfake-a za diskreditaciju javnih ličnosti i institucija

Jedan od najčešćih načina zloupotrebe deepfake tehnologije je kreiranje lažnih videa ili fotografija javnih ličnosti, kao što su političari, poznate ličnosti i lideri institucija, sa ciljem da se ukalja njihov ugled ili promeni javno mnjenje. Na primer, političar može biti prikazan u video-snimku kako izgovara uvredljive ili kontroverzne izjave koje nikada nije izrekao. Takvi sadržaji mogu uticati na stavove birača, stvarajući lažnu sliku o javnim ličnostima i manipulišući mišljenjem javnosti.

Deepfake-ovi mogu biti naročito opasni u političkim kampanjama, gde čak i kratkotrajno verovanje u lažnu informaciju može promeniti ishod izbora. Na primer, lažni video može se kreirati da izgleda kao da neki politički lider priznaje nezakonite radnje ili izgovara neprimerene stavove, što može uticati na poverenje građana i izazvati haos u političkoj sferi. U kombinaciji sa društvenim mrežama, ovi lažni sadržaji mogu se proširiti brzinom svetlosti i dosegnuti milione ljudi pre nego što se utvrdi da su falsifikati.

Opasnost po bezbednost i privatnost pojedinaca

Pored političke manipulacije, deepfake tehnologija može biti upotrebljena i za kršenje privatnosti pojedinaca. Kriminalci mogu napraviti lažne video-snimke ili fotografije pojedinaca, često s namerom da ih ucenjuju, uznemiravaju ili naruše njihovu reputaciju. U takvim slučajevima, osobe mogu biti prikazane u situacijama koje društvo osuđuje, što može imati ozbiljne posledice na njihov privatni i profesionalni život.

Deepfake tehnologija takođe može biti zloupotrebljena za prevare u kojima napadači manipulišu glasom ili likom određene osobe kako bi došli do osetljivih informacija ili novca. Na primer, zabeležen je slučaj kada su prevaranti iskoristili imitaciju glasa da ubede direktore kompanija da prebace velike sume novca na njihove račune.

Socijalni i psihološki uticaj deepfake-a

Jedan od značajnih aspekata negativnog uticaja deepfake-a je njegov socijalni i psihološki efekat na javnost. Čak i nakon što se otkrije da je sadržaj lažan, on često ostavlja trajan utisak i sumnju među ljudima. U slučajevima kada se javna ličnost diskredituje putem deepfake-a, poverenje javnosti u institucije i lidere može se trajno narušiti, čak i ako se kasnije dokaže da je sadržaj bio falsifikovan. Ovaj fenomen se naziva “efekat produženog dejstva” („the continued influence effect“) i podrazumeva da ljudi i dalje zadržavaju deo verovanja u lažnu informaciju, čak i nakon njenog pobijanja i opovrgavanja.

Pored toga, čest kontakt sa deepfake sadržajem može dovesti do toga da ljudi počinju da sumnjaju u sve što vide na mreži, uključujući i stvarne informacije. Ovo može dovesti do stanja „informacionog cinizma,“ gde pojedinci više ne veruju medijima i zvaničnim izvorima, što dodatno podriva stabilnost i poverenje u društvo.

Izazovi u borbi protiv deepfake-a

Prepoznavanje i sprečavanje deepfake sadržaja predstavlja veliki izazov za društvo i tehnologiju. Iako se razvijaju alati za otkrivanje deepfake-a, kao što su softveri za analizu piksela, audio-karakteristika i drugih vizuelnih detalja, ti alati još uvek nisu dovoljno precizni. Deepfake tehnologija takođe napreduje i postaje sve sofisticiranija, zbog čega postoji stalna „trka“ između stvaralaca deepfake-a i onih koji pokušavaju da ih detektuju.

Sa pravne strane, postoje pokušaji da se deepfake manipulacije regulišu i kažnjavaju. U nekim zemljama su uvedeni zakoni koji zabranjuju i sankcionišu zlonamernu upotrebu deepfake tehnologije, ali su ovi pravni okviri I regulative i dalje u razvoju. Mnoge države tek treba da utvrde jasne zakone i mere koje bi omogućile efikasnu borbu protiv ove vrste digitalnog kriminala.

Zaključak

Deepfake tehnologija je snažan i inovativan alat, ali je takođe i opasan instrument koji se može zloupotrebiti za manipulaciju javnim mnjenjem, diskreditaciju ličnosti i institucija, kršenje privatnosti i organizovanja raznih vrsta prevara. Sa porastom dostupnosti tehnologija i tehnološkog napretka, izazov je kako za tehnološke stručnjake, tako i za društvo u celini da razviju efikasne metode za prepoznavanje i ograničavanje negativnih efekata ove tehnologije. Samo uz razvoj sofisticiranih alata za detekciju, odgovarajuće pravne mere i edukaciju javnosti, možemo se zaštititi od štetnih efekata deepfake-a i očuvati poverenje u informacije koje nas okružuju.

Nastaviće se…

Milena Šović, M.Sc.,CSM

Prompt Engineer & AI Educator